IA Act : que dit la loi européenne sur l’intelligence artificielle ?

L’intelligence artificielle est en train de redessiner profondément nos économies, nos sociétés, et nos façons de travailler. ChatGPT, DALL·E, outils prédictifs… jamais une technologie n’avait autant fasciné, inquiété et transformé en si peu de temps. Si l’IA ouvre des perspectives révolutionnaires, elle soulève aussi des questions éthiques majeures : biais algorithmiques, opacité des décisions automatisées, atteintes aux droits fondamentaux, ou encore manipulation de l’information.

Face à ces enjeux, l’Union européenne a fait un choix clair : anticiper, encadrer, et poser les fondations d’une intelligence artificielle digne de confiance. C’est tout le sens du AI Act (ou Règlement sur l’intelligence artificielle), premier cadre réglementaire au monde spécifiquement dédié à cette technologie. En imposant des obligations différenciées selon les usages, l’UE entend favoriser une IA éthique, transparente et conforme aux valeurs européennes.

1. Une loi historique : genèse, enjeux et adoption du AI Act

Une initiative née d’un constat d’urgence

L’IA Act n’est pas né dans l’urgence médiatique des IA génératives, mais d’un travail de fond lancé dès 2018 par la Commission européenne. À l’époque, le constat est clair : l’Europe accuse un retard technologique dans le domaine de l’IA face aux géants américains et chinois, mais elle peut imposer ses règles du jeu sur un terrain où elle excelle : la régulation technologique fondée sur les droits fondamentaux.

Inspirée par le succès du RGPD (Règlement Général sur la Protection des Données), l’UE souhaite appliquer le même niveau d’exigence à l’IA. Une première ébauche de stratégie voit le jour en 2020, suivie d’un livre blanc et de vastes consultations publiques auprès d’entreprises, chercheurs, ONG et États membres.

Un cadre légal ambitieux, unique au monde

Le projet de règlement est officiellement présenté en avril 2021. Il repose sur deux piliers :

- Une approche basée sur les risques, plutôt que sur la technologie elle-même

- Un objectif de protection des citoyens tout en favorisant une innovation responsable

Le texte a connu un parcours parlementaire complexe, notamment sur les questions de surveillance biométrique, d’IA générative et de souveraineté. Il est finalement adopté en décembre 2023 par le Parlement européen, puis validé définitivement en mars 2024.

Mise en application progressive

Le calendrier d’entrée en vigueur du règlement est étalé pour permettre aux entreprises de s’adapter :

- 1er août 2024 : Entrée en vigueur du règlement.

- 2 février 2025 : Interdiction des IA à risque inacceptable.

- 2 août 2025 : Règles pour les modèles d’IA à usage général et désignation des autorités compétentes.

- 2 août 2026 : Application aux IA à haut risque déjà identifiées.

- 2 août 2027 : Extension aux IA à haut risque dans certains produits réglementés (jouets, dispositifs médicaux, etc.).

Chaque État membre désignera une autorité nationale de supervision, appuyée par un AI Office européen chargé de coordonner la mise en œuvre.

2. IA Act : un cadre structuré par niveaux de risque

Plutôt que d’interdire ou d’autoriser l’IA de manière binaire, le règlement repose sur une typologie des systèmes IA selon leur niveau de risque, avec des obligations adaptées à chaque cas.

| Niveau de risque | Description | Exemples | Conséquences |

|---|---|---|---|

| Risque inacceptable | Usages contraires aux valeurs fondamentales de l’UE. | Notation sociale, manipulation cognitive, surveillance biométrique de masse. | Strictement interdits. |

| Risque élevé | IA utilisée dans des domaines sensibles ayant un impact significatif sur les droits ou la sécurité des personnes. | Recrutement, justice, santé, éducation, infrastructures critiques. | Soumise à des obligations strictes de conformité (évaluation, documentation, supervision humaine…). |

| Risque limité | Systèmes ayant un impact modéré sur les utilisateurs. | Chatbots, assistants virtuels, recommandations de contenu. | Obligation d’information (l’utilisateur doit savoir qu’il interagit avec une IA). |

| Risque minimal | Usages sans impact sensible identifié. | Filtres antispam, suggestions automatiques, IA dans les jeux vidéo. | Libre utilisation sans obligation spécifique. |

3. Ce que l’IA Act impose aux entreprises

Obligations pour les IA à haut risque

Les entreprises qui développent ou déploient des IA considérées à haut risque devront :

- Évaluer leur conformité via une procédure d’évaluation

- Documenter la conception, les données d’entraînement, les tests et l’usage

- Garantir une supervision humaine appropriée

- Appliquer des mesures contre les biais et assurer une traçabilité

- Fournir une notice d’utilisation explicite aux utilisateurs

Les systèmes devront être enregistrés dans une base de données européenne des IA à haut risque.

Focus sur les modèles de fondation et l’IA générative

Avec l’explosion de l’IA générative (type ChatGPT, Copilot, Bard…), le législateur a intégré un volet spécifique.

Les développeurs de modèles dits de fondation (foundation models) devront fournir :

- Une description détaillée du modèle et de ses capacités

- Une transparence sur les données d’entraînement

- Des garanties sur le respect des droits d’auteur

- Les contenus générés par IA devront être clairement signalés comme tels

‼ Sanctions en cas de non-conformité

Le règlement prévoit des amendes administratives très dissuasives :

- Jusqu’à 35 millions d’euros ou 7 % du chiffre d’affaires mondial

- Des sanctions proportionnelles à la gravité de l’infraction

4. Quelles conséquences concrètes pour les entreprises ?

Qui est concerné ?

Le règlement s’applique à toutes les organisations — entreprises, associations ou administrations — qui fournissent, distribuent ou déploient des systèmes d’intelligence artificielle dans l’Union européenne, qu’elles soient établies dans l’UE ou en dehors.

Les acteurs les plus directement concernés sont ceux qui envisagent d’introduire ou de mettre en service des systèmes d’IA à haut risque sur le marché européen.

En résumé, toute organisation qui conçoit, utilise ou intègre de l’Intelligence Artificielle dans ses processus peut être concernée par l’IA Act.

Quel impact ?

Les entreprises devront se conformer à des exigences rigoureuses :

- Obtenir un marquage CE pour les systèmes à haut risque

- Mettre en place une gestion des risques adaptée

- Fournir une documentation technique complète

- Déclarer la conformité de leurs systèmes

- Garantir la cybersécurité, la transparence et la traçabilité des données utilisées

Elles devront également assurer un contrôle humain sur les décisions prises par l’IA.

Un soutien spécifique pour les PME

Les petites et moyennes entreprises bénéficieront d’un cadre favorable pour adopter l’IA en toute sécurité, notamment grâce aux bacs à sable réglementaires.

Ces environnements encadrés permettent de tester des solutions innovantes, y compris en conditions réelles, sous la supervision d’un régulateur, avec une certaine flexibilité temporaire sur les obligations légales. Ils offrent ainsi un levier précieux pour expérimenter, évaluer les risques et adapter la réglementation, tout en garantissant la conformité des projets.

À noter : La mise en œuvre de ces mesures dépendra des modalités d’application concrètes du règlement dans chaque État membre de l’UE.

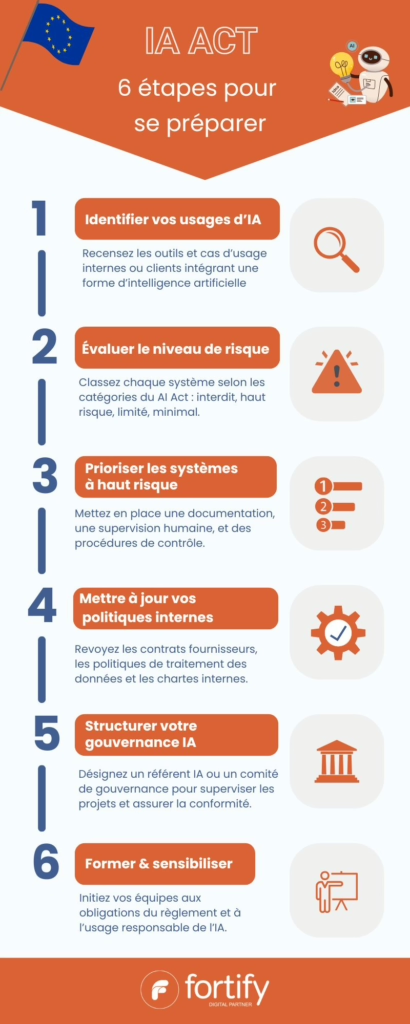

5. Comment se préparer dès maintenant ?

- Identifier vos usages d’IA : Recensez les outils et cas d’usage internes ou clients intégrant une forme d’intelligence artificielle.

- Évaluer le niveau de risque : Classez chaque système selon les catégories du AI Act : interdit, haut risque, limité, minimal.

- Prioriser les systèmes à haut risque : Mettez en place une documentation, une supervision humaine, et des procédures de contrôle.

- Mettre à jour vos politiques internes : Revoyez les contrats fournisseurs, les politiques de traitement des données et les chartes internes.

- Structurer votre gouvernance IA : Désignez un référent IA ou un comité de gouvernance pour superviser les projets et assurer la conformité.

- Former & sensibiliser : Initiez vos équipes aux obligations du règlement et à l’usage responsable de l’IA.

6. Opportunités et défis pour les acteurs économiques

✅ Des opportunités à saisir

L’IA Act, loin d’être un frein à l’innovation, peut devenir un levier stratégique pour les entreprises. Elle peut permettre de :

- Renforcer la confiance : en adoptant une IA éthique et transparente, les organisations améliorent leur image et rassurent leurs clients, collaborateurs et partenaires.

- Structurer la gouvernance IA : le règlement incite à clarifier les responsabilités, sécuriser les usages et professionnaliser les processus.

- Anticiper les futures régulations : se mettre en conformité avec l’IA Act, c’est prendre une longueur d’avance sur les normes mondiales à venir.

- Encourager une innovation responsable : le cadre réglementaire favorise des cas d’usage utiles, maîtrisés et mieux alignés avec les attentes sociétales.

⚠️ Des défis à relever

- Comprendre et interpréter la réglementation : la classification des risques et les obligations associées nécessitent une bonne maîtrise juridique et technique.

- Adapter les projets IA existants : les systèmes à haut risque doivent répondre à des exigences renforcées (documentation, supervision, transparence…).

- Mobiliser les bonnes compétences : il nécessaire de coordonner data, juridique, conformité, DPO et métiers autour de ces enjeux.

- Auditer les solutions IA tierces : les obligations de conformité s’étendent aussi aux fournisseurs et partenaires technologiques.

En résumé : l’IA Act impose un effort d’adaptation, mais il peut aussi devenir un avantage concurrentiel pour les entreprises qui s’en emparent dès maintenant.

Conclusion : une régulation de rupture pour une IA de confiance

Avec l’IA Act, l’Europe envoie un signal fort : l’innovation ne doit pas se faire au détriment des droits fondamentaux. Ce règlement pionnier place l’UE en position de leadership éthique dans un monde technologique en tension.

Les entreprises, grandes ou petites, doivent désormais intégrer ces nouvelles exigences dans leurs projets d’intelligence artificielle. L’IA Act n’est pas une contrainte, mais une opportunité stratégique pour construire une IA utile, explicable et responsable.

📎 Ressources à consulter :

- Texte officiel sur l’IA Act

- Fiche explicative IA Act – Commission européenne

- Note de synthèse – CNIL sur l’IA Act

Publié le 15/05/2025